课程介绍:

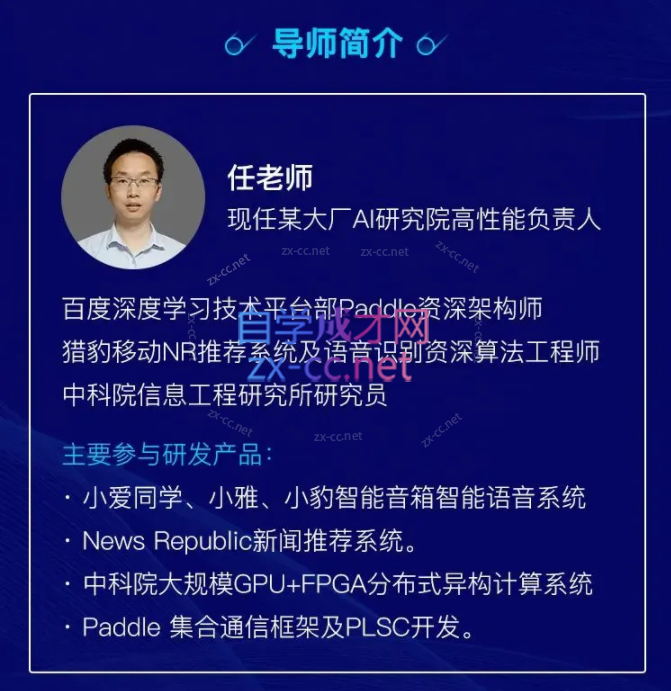

课程由现任某大厂AI研究院高性能负责人的任老师主讲

首席AI架构师-分布式高性能深度学习实战培养计划

培养:理论与实践兼备的AI架构师

推动:企业深度学习高效部署、落地

打造:深度学习高端技术交流圈

课程亮点

各大AI框架设计原理讲解:Tensorflow、Pytorch、PaddlePaddle.TNN等

全面覆盖深度学习应用场景:语音、视觉、推荐,三大性能提升项目实战

AI项目落地全链路流程详解:深度学习系统设计 、并行计算优化、部署优化、应用

工业界博导级大咖导师:曾参与“小爱同学”,“Paddle’“News Republic”研发

核心内容知识点

CUDA、 Cupy、 Numba、TensorRT、TNNo计算图优化 、算子融合、GMM Attention、 Forward Attention 、tts 、 Tacotron2、FastSpeech 、durlAN、 Parameter Server、 DeepFM YOLO、SSD、MPI、 OpenMP、NCCL、 winograd 、local sgd、 GE2E、Distilling、KL模型量化

你将收获

1掌握CUDA、MPI、OPENMP等常用并行计算库的使用

2掌握TensorRT、TNN等常用部署框架的设计及使用,助力快速模型上线

3掌握模型量化、压缩、裁剪、混合精度训练等常用优化方法

4掌握业界经典的TTS、推荐系统、图像目标检测模型结构设计及相应优化方案

5掌握MPI、OPENMP、CUDA等不同层级的并行计算方案

适合人群

大学生

计算机相关专业的本科/硕士/博士生

希望在深度学习应用外掌握深度学习框架的设计

希望具备框架二次开发,验证新算法

在职人士

具备工程研发背景,希望从事AI相关的项目工作希望

具备深度学习从框架到部署优化全链路能力

提升在模型部署中遇到的性能相关问题解决能力

希望针对框架进行二次开发的能力

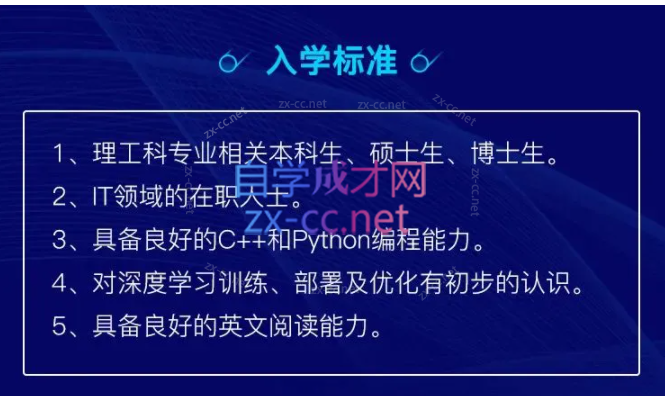

入学标准

1、理工科专业相关本科生、硕士生、博士生。

2、IT领域的在职人士。

3、具备良好的C++和Python编程能力。

4、对深度学习训练、部署及优化有初步的认识

5、具备良好的英文阅读能力。

阶段一: 基础准备及概述

阶段二:目标检测项目

内容简介

目标检测计算机视觉中的经典问题。目前已经广泛应用在行人跟踪、车牌识别、无人驾驶等领域。基于深度学习的目标检测算法由于具有较高的识别准确率逐渐成为主流。目标检测算法对实时性要求较高,本项目着力于解决这一问题。

学习目标

通过目标检测这类以卷积模块为主的模型的解构掌握并能够上手自己动手实现卷积等常规的神经网络算子,并使用TensorRT框架完成基于GPU的目标检测测项目的部署。

阶段三:个性化语音合成项目实战

内容简介

智能化的读书功能,允许选择语音音色来进行听书导航的智能语音-如百度地图、高德地图、传统Garmin导航等,都支持选择不同语言进行实时导航。智能音箱-喜马拉雅FM的小雅、科大讯飞的智能语音输入,支持辨识活体语音,进行反馈处理再以语音方式反馈回复。这些问题背后都是基于Seg2Seg的深度学习合成模型,该模型结构复杂计算量大,本项目旨在通过通过优化解决这一问题

学习目标

掌握个性化语音合成中经典的声纹提取、基于Attention的合成模型、以及典型的基于卷积网络的声码器设计。在此基础上掌握基于ONNX的通用模型转换技术及基于TensorRT来进行模型部署推理加速。

阶段四:分布式推荐系统

内容简介

头条新闻推荐、抖音短视频推荐、京东商品推荐个性化推荐已经成为现代人们生活的一部分。推荐系统特征往往具备稀疏性的问题,如果解决大规模稀疏模型的训练时本项目拟解决的问题。

学习目标

通过推荐系统这一大规模稀疏特征特性的模型结构,了解参数服务器的设计以及分布式环境下的反向传播算法的实现,以及常见梯度计算优化算法Local SGD,同时具备常用推荐模型的应用部署能力。

阶段五: 深度学习高级主题

内容简介

深度学习框架日新月异。国际上有Tensorflow.Pytorch、Keras等框架,国内有PaddlePaddle旷世天元,清华计图等框架,那么这些框架遵循怎样的设计理念和发展发现,本阶段内容通过梳理典型框架的设计来让学员对这些问题有更为清晰和直观的认识。

学习目标

掌握深度学习架构的设计思想及技术演进,通过对核心的框架通信技术的解读以及经典的图优化算子融合等技术的讲解,让读者未来对框架的使用更加熟练。

阶段六: 结业答辩

课程截图:

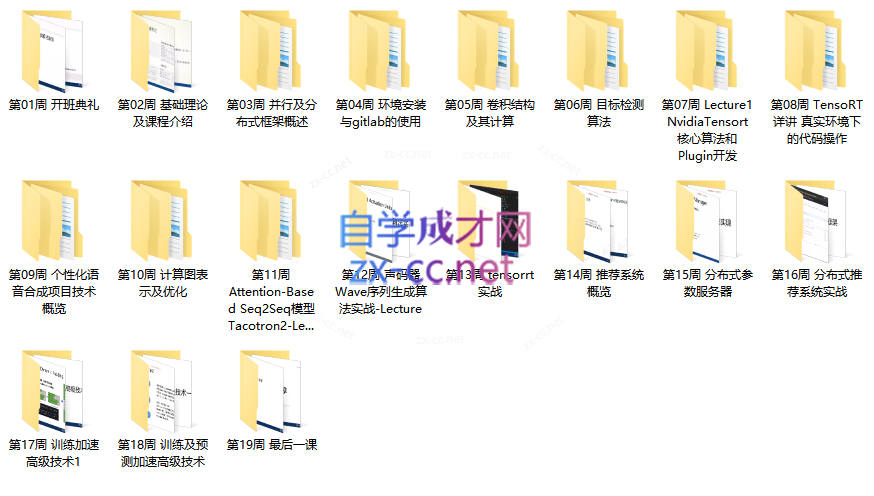

课程目录:

贪心科技-首席AI架构师 分布式高性能深度学习实战培养计划

├第01周 开班典礼

开班典礼1.mp4

开班典礼2.mp4

开班典礼3.mp4

├第02周 基础理论及课程介绍

lecture1.mp4

lecture2.mp4

review1.mp4

review2.mp4

review3.mp4

├第03周 并行及分布式框架概述

01.框架概述

│ 并行及分布式框架概述1.mp4

│ 并行及分布式框架概述2.mp4

│ 并行及分布式框架概述3.mp4

│ 并行及分布式框架概述4.mp4

│ 并行及分布式框架概述5.mp4

02.代码实战

│ 代码实战课程1.mp4

│ 代码实战课程2.mp4

│ 代码实战课程3.mp4

03.阅读paper

│ 如何阅读Paper1.mp4

│ 如何阅读Paper2.mp4

├第04周 环境安装与gitlab的使用

01.环境安装与gitlab的使用

│ 环境安装与gitlab的使用1.mp4

│ 环境安装与gitlab的使用2.mp4

02.经典并行模式

│ 经典并行模式1.mp4

│ 经典并行模式2.mp4

03.Speaker-Aware Talking-Head Animation

│ SpeakerAwareTalkingHeadAnimation1.mp4

│ SpeakerAwareTalkingHeadAnimation2.mp4

├第05周 卷积结构及其计算

01.卷积结构及其计算

│ 卷积结构及其计算1.mp4

│ 卷积结构及其计算2.mp4

│ 卷积结构及其计算3.mp4

│ 卷积结构及其计算4.mp4

02.EFFICIENT WINOGRAD CONVOLUTION VIA INTEGER ARITHMETIC

│ EFFICIENTWINOGRADCONVOLUTIONVIAINTEGERARITHMETIC1.mp4

│ EFFICIENTWINOGRADCONVOLUTIONVIAINTEGERARITHMETIC2.mp4

03.前后向算法

│ 前后向算法1.mp4

│ 前后向算法2.mp4

├第06周 目标检测算法

01.目标检测算法

│ 目标检测算法1.mp4

│ 目标检测算法2.mp4

│ 目标检测算法3.mp4

│ 目标检测算法4.mp4

│ 目标检测算法5.mp4

02.Distilling the Knowledge in a Neural Network

│ DistillingtheKnowledgeinaNeuralNetwork.mp4

├第07周 Lecture1 NvidiaTensort核心算法和Plugin开发

Lecture1NvidiaTensort核心算法和Plugin开发

│ NvidiaTensort核心算法和Plugin开发-01.mp4

│ NvidiaTensort核心算法和Plugin开发2.mp4

│ NvidiaTensort核心算法和Plugin开发3.mp4

│ NvidiaTensort核心算法和Plugin开发4.mp4

PaperDistillingheKnowledgeinaNeuralNetwork

│ Paper Distilling the Knowledge in a Neural Network.mp4

├第08周 TensoRT详讲 真实环境下的代码操作

DynamicetworkSurgeryorEfficientDNNs

│ DynamicNetworkSurgeryforEfficientDNNs.mp4

LectureTensoRT详讲真实环境下的代码操作

│ TensoRT详讲真实环境下的代码操作1.mp4

│ TensoRT详讲真实环境下的代码操作2.mp4

│ TensoRT详讲真实环境下的代码操作3.mp4

│ TensoRT详讲真实环境下的代码操作4.mp4

TensorRTpluginnmsPlugin这个plugin插件的具体

│ 插件的具体代码实现1.mp4

│ 插件的具体代码实现2.mp4

│ 插件的具体代码实现3.mp4

├第09周 个性化语音合成项目技术概览

Improving Neural Network Quantization without Retraining using

│ ImprovingNeuralNetworkQuantization.mp4

Lecture 个性化语音合成项目技术概览

│ 个性化语音合成项目技术概览1.mp4

│ 个性化语音合成项目技术概览2.mp4

│ 个性化语音合成项目技术概览3.mp4

TensorRT SSD 推理

│ TensorRTSSD推理1.mp4

│ TensorRTSSD推理2.mp4

├第10周 计算图表示及优化

WorkshopData-Free Knowledge Distillation for Deep Neural Networks

│ DataFreeKnowledgeDistillationforDeepNeuralNetworks.mp4

计算图表示及优化

│ 计算图表示及优化1.mp4

│ 计算图表示及优化2.mp4

│ 计算图表示及优化3.mp4

│ 计算图表示及优化4.mp4

├第11周 Attention-Based Seq2Seq模型Tacotron2-Lecture

1-Lecture Attention-Based Seq2Seq模型Tacotron2

│ AttentionBasedSeq2Seq模型Tacotron21.mp4

│ AttentionBasedSeq2Seq模型Tacotron22.mp4

│ AttentionBasedSeq2Seq模型Tacotron23.mp4

│ AttentionBasedSeq2Seq模型Tacotron240.mp4

2-Workshop 说话人特征提取技术实现及环境搭建

│ 说话人特征提取技术实现及环境搭建1.mp4

│ 说话人特征提取技术实现及环境搭建2.mp4

3-Workshop Rethinking the Smaller

│ RethinkingtheSmaller1.mp4

│ RethinkingtheSmaller2.mp4

4-Workshop 代码练习

│ 代码练习1.mp4

├第12周 声码器Wave序列生成算法实战-Lecture

PAYINGMOREATTENTIONTOATTENTIONIMPROVINGTHEPERFORMANCE.mp4

Tacotron2合成模型实现1.mp4

Tacotron2合成模型实现2.mp4

声码器Wave序列生成算法实战1.mp4

声码器Wave序列生成算法实战2.mp4

声码器Wave序列生成算法实战3.mp4

声码器Wave序列生成算法实战4.mp4

├第13周 tensorrt实战

PerformanceGuaranteedNetworkAccelerationviaHighOrderResidualQuantization.mp4

tensorrt实战1.mp4

tensorrt实战2.mp4

tensorrt实战3.mp4

tensorrt实战4.mp4

tensorrt实战5.mp4

├第14周 推荐系统概览

SimpleResourceConstrainedStructureLearningofDeepNetworks.mp4

作业讲解1.mp4

作业讲解2.mp4

常用Attention的实现1.mp4

常用Attention的实现2.mp4

推荐系统概览1.mp4

推荐系统概览2.mp4

推荐系统概览3.mp4

推荐系统概览4.mp4

├第15周 分布式参数服务器

HorovodfastandeasydistributeddeeplearninginTensorFlow.mp4

Horovodtensorflow应用1.mp4

Horovodtensorflow应用2.mp4

分布式参数服务器1.mp4

分布式参数服务器2.mp4

分布式参数服务器3.mp4

分布式参数服务器4.mp4

├第16周 分布式推荐系统实战

Difacto中SGD算法的实现1.mp4

Difacto中SGD算法的实现2.mp4

DistributedTrainingStrategiesfortheStructuredPerceptron.mp4

Mixed Precision Training.mp4

分布式推荐系统实战1.mp4

分布式推荐系统实战2.mp4

分布式推荐系统实战3.mp4

分布式推荐系统实战4.mp4

分布式推荐系统实战5.mp4

深度学习框架技术-1.mp4

深度学习框架技术-2.mp4

深度学习框架技术-3.mp4

深度学习框架技术-4.mp4

├第17周 训练加速高级技术1

Local SGD Converges Fast and Communicates Little.mp4

TNN高效存储管理机制-1.mp4

TNN高效存储管理机制-2.mp4

训练及预测加速高级技术-1.mp4

训练及预测加速高级技术-2.mp4

训练及预测加速高级技术-3.mp4

训练及预测加速高级技术-4.mp4

训练及预测加速高级技术-5.mp4

训练及预测加速高级技术-6.mp4

├第18周 训练及预测加速高级技术

模型压缩技术实现-1.mp4

模型压缩技术实现-2.mp4

训练加速高级技术1-1.mp4

训练加速高级技术1-2.mp4

训练加速高级技术1-3.mp4

训练加速高级技术1-4.mp4

训练加速高级技术1-5.mp4

训练加速高级技术1-6.mp4

├第19周 最后一课

Fast Locality Sensitive Hashing for Beam Search on GPU.mp4

最后一课-1.mp4

最后一课-2.mp4

评论(0)